诡谷子AI的双目视觉算法刷新了国际最权威排名纪录

2022年6月13号北京大学深圳研究生院赵勇团队诡谷子人工智能开放实验室的双目视觉立体匹配算法刷新了国际最权威排名纪录,算法核心指标全球排名第一。

双目视觉算法是智能机器人、自动驾驶、无人机导航、以及智慧机器人导航等产业AI应用的关键算法,对于计算机视觉领域和三维立体感知等AI技术,具有十分重要的意义。

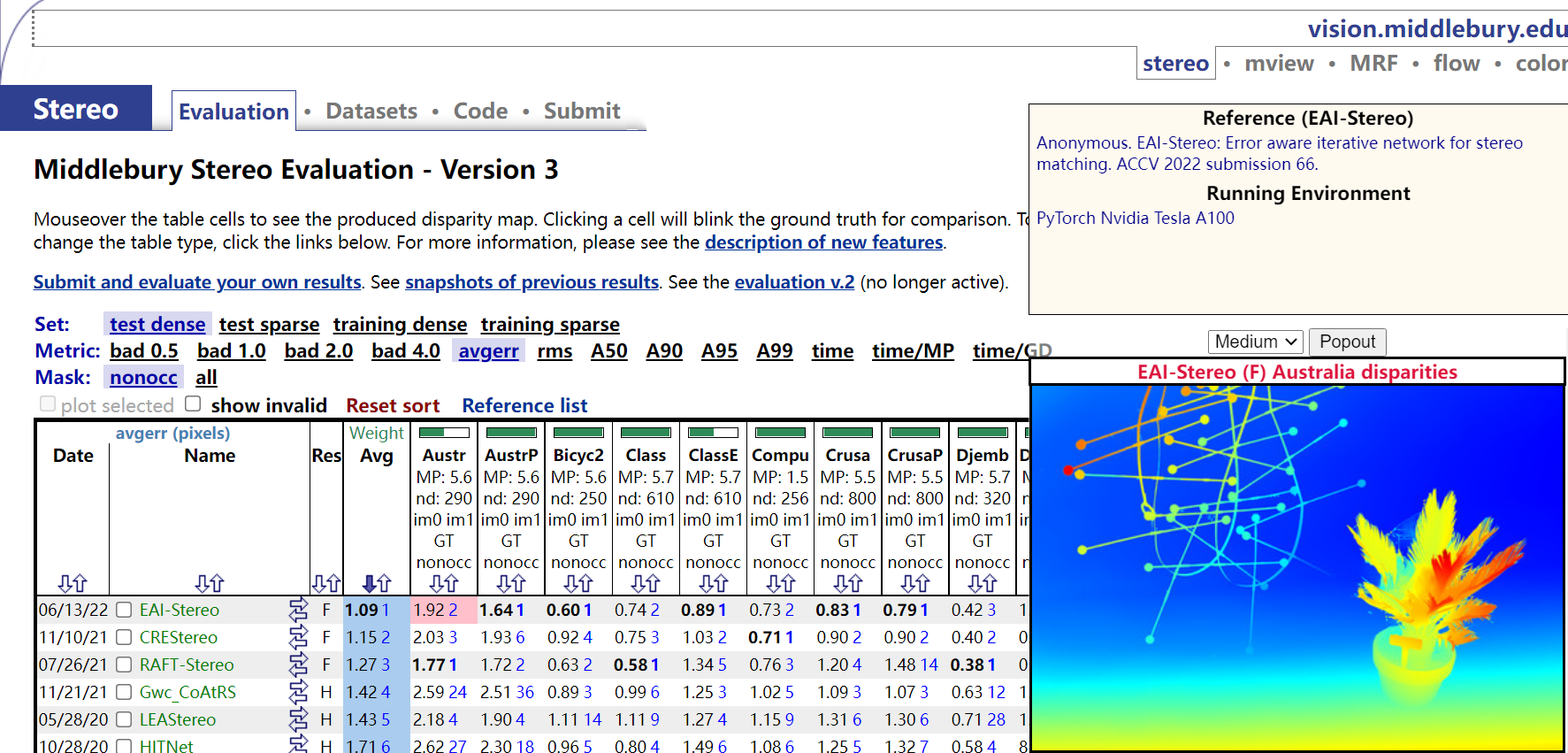

诡谷子AI开放实验室开发的双目视觉立体匹配算法EAIStereo (EAI-Stereo: Error aware iterative network for stereo matching)在双目视觉算法最权威、最专业的排名Middlebury Evaluation V3(明德学院)评估中名列国际同行第一,其中对于所有像素的平均准确率提升8.6%(平均错误率从2.102降至1.921),对于非遮挡像素检测的平均准确率比排名第二的算法提升了5.3%(平均错误率从1.152降至1.091),相对第二名的算法具有非常显著性的提升,而且在几乎所有分项指标中均显著高于第二名。该算法性能超过了包括谷歌HITNet、普林斯顿RAFTstereo、牛津大学的GANet、东京大学LocalExp等算法。

虽然计算机视觉的能力在新一代人工智能技术-深度学习的驱动下得到大幅提升,但大多数都是在两维图像上,其最大的局限是缺乏立体信息和深度信息。因此,近年来,计算机视觉不断向3D图像发展,在最近的重要的计算机视觉的相关会议如CVPR,ICCV, ECCV等会议上,有关3D视觉的研究占到三分之一到二分之一的份量。目前3D感知与建模主要依赖于激光雷达LIDAR,飞行时间TOF光栅以及结构光的方法,对于不连续的物体表面,遮挡等复杂情况,这些方法的3D重建会出现病态而且缺乏颜色及纹理信息从而限制了其广泛应用。

双目视觉是3D感知中一个最有潜力的、最拟人化的,能同时提供颜色和深度信息(完备的RGBD感知)的一种方法。在3D网格重建、SLAM(定位与建图)能力、场景认知能力和3D目标检测、3D目标识别、6D姿态检测、自动驾驶、室内导航、智能机器人定位与测量等方面有非常广泛的应用。目前为止,业内仍未有成熟高效实用的面向嵌入式系统的实时双目视觉立体匹配算法。当前很多嵌入式系统配备了双目视觉的硬件接口(包括大疆、海思等SOC芯片系统),都采用由H. Hirschmuller [16] (CVPR2005)提出的开源的半全局算法SGM算法,准确率只有75%左右,其性能难以满足很多要求较高的应用场景。

诡谷子AI开放实验室研究团队,近年来一直致力于双目视觉的立体匹配算法与网络的研究,已获双目视觉专利十多项,并已在权威期刊和会议发表双目视觉论文50多篇,其中诡谷子AI开放实验室(2020-7月)提出的的算法HLocalExp-CM在明德学院评估的关键指标即误差不超过2像素指标排名第一(且时间长达一年左右),由诡谷子AI开放实验室(2021-5月)所提出的LocalExp-RC也在明德学院评估的关键指标(误差不超过1像素)排名第一。

近年,随着AI技术不断进步,正加速产业落地应用,但是越来越多的设备数据无法依赖云端的处理能力,这就要求设备能够在现场分析和评估图像/数据,而不能依赖云端AI。这样就需要采用边缘人工智能技术,在本地设备都能处理的AI算法。

诡谷子团队正在将该双目视觉的研究成果应用于自动驾驶、无人机避障、机器人感知等领域,探索低成本、低功耗、高鲁棒性的双目视觉算法模组、产品或系统,促进双目视觉算法的产业化应用,相信这将会对业界双目视觉产业应用的发展起到积极的推动作用。

诡谷子人工智能科技(深圳)有限公司、诡谷子AI开放实验室是由北京大学深圳研究生院师生所创立,位于深圳美丽的石岩湖畔的北大科创园。该园是北京大学面向服务深圳及粤港澳大湾区科技创新所建立的前沿科技的研发、培训以及孵化园区。

该实验室的学术委员会由多位北大的学术大咖组成。该实验室团队曾参与开发了全球销量最大(销售额数十亿)的监控芯片中的视频加速引擎IVE2.0,主持研发了国内首款疲劳驾驶检测仪,获得过国内第一届创新创业大赛第一名,与迈瑞、华为、腾讯、华大等企业开展过深度合作研发。

近年,团队开发出国内首个无线自组网协议栈、异形器件AI柔性自动插件机器人,AI电梯挂件自动检测系统机器人,高速瞬检全尺寸光学测量机,PCB裸板的AVI自动检测系统等一列AI产业应用成果,创造良好的社会效益和经济效益。

最近,为了促进中国人工智能产业应用的发展,助企业自主创新与转型升级,诡谷子AI开放实验室正面向社会提供:产业AI、机器视觉等AI算法赋能和嵌入式AI应用培训服务。

诡谷子致力于AI技术领域耕耘与创新,在自主研发的深度学习平台上,开发了一种基于深度神经网络的立体匹配算法,不久将来随着诡谷子AI双目视觉产业应用落地,相信将会促进国内自动驾驶、无人机导航、以及智能机器人导航等行业的发展。

-

诡谷子AI的双目视觉算法刷新了国际最权威排名纪录

06-16 16:10

-

【产品经理说产品】2022首播,建成全省“一张网”,落地全国“大市场”

06-16 15:51

-

青山绿水升起金融“融合云”,吉林农信携手新华三共谱乡村振兴科技新曲

06-16 15:34

-

从海南论道,看2022智能视听如何开势破局

06-16 15:33

-

云捷亮数:创新升级助力品牌突围战略困局

06-16 15:21

-

华为云2022技术论坛开幕:云原生2.0全面升级,让创新服务触手可及

06-16 14:59

-

年中“拔草”实例:这块硬盘谁家还没有?

06-16 14:56

-

“华为伙伴暨开发者大会2022”召开 中建信息再添荣誉

06-16 14:45

-

“华为伙伴暨开发者大会2022”召开 中建信息再添荣誉

06-16 14:45

-

过时笔记本为何重焕新春?TiPlus5000告诉你

06-16 14:31